Po co programiście AI: kontekst, liczby i zmiana roli

Od „klepacza kodu” do inżyniera rozwiązań

Sztuczna inteligencja w pracy programisty nie jest już ciekawostką, tylko codziennym narzędziem. Zmienia się zakres zadań: mniej ręcznego klepania oczywistego kodu, więcej pracy nad zrozumieniem problemu, architekturą i wpływem na biznes. AI w programowaniu potrafi wygenerować fragment rozwiązania, ale to programista decyduje, jaki problem rzeczywiście trzeba rozwiązać i jak ocenić jakość propozycji.

Coraz częściej zespoły IT są rozliczane nie z liczby linii kodu, ale z czasu dostarczenia wartości. Narzędzia AI w programowaniu przyspieszają:

- tworzenie boilerplate’u (kontrolery, DTO, mapery, konfiguracja),

- pisanie testów jednostkowych i integracyjnych,

- generowanie dokumentacji technicznej i README,

- przygotowywanie proof-of-concept (POC) i prototypów UI/CLI,

- proste migracje między bibliotekami i frameworkami.

Rolą programisty staje się więc mniej „manualne pisanie wszystkiego od zera”, a bardziej:

- formułowanie wymagań i ograniczeń,

- ocena poprawności i bezpieczeństwa kodu od AI,

- integracja wygenerowanych fragmentów z resztą systemu,

- dbanie o spójność architektury i standardów w projekcie.

Gdzie AI daje największy zysk czasowy

Największy przyrost efektywności widać tam, gdzie zadania są powtarzalne, dobrze ustrukturyzowane i mają wiele przykładów w publicznych repozytoriach. AI dla programistów szczególnie dobrze radzi sobie z:

1. Boilerplate i kod niskiej kreatywności

Przykład: typowy CRUD w Spring Boot, REST API w NestJS, formularz w React z walidacją, konfiguracja routingu w Next.js. Narzędzie typu Copilot, Codeium czy Tabnine jest w stanie uzupełnić większość kodu na podstawie kilku nazw klas, metod i komentarza TODO.

2. Testy jednostkowe na istniejący kod

AI potrafi na podstawie implementacji wygenerować szkic testów w JUnit, pytest czy Jest. Nie będzie to kompletny zestaw scenariuszy, ale bardzo przyspiesza start – zamiast pisać wszystko ręcznie, programista usuwa oczywiste bzdury, dodaje przypadki brzegowe i integruje testy z pipeline’em CI.

3. Dokumentacja i przykłady użycia

Z kodu kontrolera można wygenerować opisy endpointów HTTP, parametry, przykładowe requesty i response’y. Z plików konfiguracyjnych – sekcję „Konfiguracja środowiska” w README. To świetnie wspiera onboardowanie nowych ludzi do zespołu.

4. Prototypy i POC

Jeśli trzeba sprawdzić nowy pomysł na feature czy integrację z API, AI potrafi w ciągu kilkudziesięciu minut pomóc zbudować działający szkic. Dalsze „dopieszczenie” należy już do zespołu, ale próg wejścia spada drastycznie.

Mit o znikających programistach a rzeczywistość rynku

Popularny mit mówi: „AI zabierze pracę programistom”. Rzeczywistość jest bardziej przyziemna: AI zabierze rynek osobom, które nie potrafią z niej korzystać i nie rozumieją, co generowany kod robi. Zmienia się profil kompetencji, a nie sama potrzeba istnienia ludzi w procesie tworzenia oprogramowania.

Organizacje coraz częściej szukają inżynierów, którzy:

- umieją formułować zadania dla AI (promptowanie techniczne),

- rozumieją architekturę i wzorce projektowe,

- potrafią ocenić jakość i bezpieczeństwo kodu z narzędzi AI,

- łączą kompetencje techniczne z rozumieniem domeny biznesowej.

Mit kontra praktyka: AI nie „zastąpi” seniora architekta systemu, który projektuje złożone przepływy, dobiera kompromisy wydajność–koszt–bezpieczeństwo. Za to może znacząco obniżyć koszt prostych zadań, które do tej pory zajmowały juniorom tygodnie. To raczej przesunięcie obowiązków niż masowe zniknięcie stanowisk.

AI a poziom doświadczenia: junior, mid, senior

Wpływ narzędzi AI na rozwój kariery programisty zależy mocno od poziomu:

Junior

Korzyści:

- szybsze odkrywanie idiomów danego języka i frameworka,

- podpowiedzi nazw zmiennych, funkcji, wzorcowych implementacji,

- łatwiejsze zadawanie pytań „dlaczego tak, a nie inaczej”.

Zagrożenie: junior, który bezrefleksyjnie akceptuje podpowiedzi, bardzo wolno uczy się podstaw. Dobrą praktyką jest przepisywanie fragmentów generowanych przez AI własnymi słowami i tłumaczenie ich koledze z zespołu – jeśli nie umiesz wyjaśnić kodu, nie rozumiesz go.

Mid

Korzyści:

- automatyzacja powtarzalnych zadań,

- szybsze uczenie się nowych bibliotek oraz refaktoryzacja,

- pomoc w projektowaniu testów i dokumentacji.

Na tym poziomie kluczowa staje się umiejętność krytycznego czytania kodu od AI oraz umiejętne przełączanie się między pracą koncepcyjną a „podrzędnymi” czynnościami, które można delegować narzędziom.

Senior

Korzyści:

- wsparcie w analizie dużych baz kodu i legacy,

- szybsze tworzenie POC-ów pod decyzje architektoniczne,

- automatyzacja powtarzalnych aspektów code review i bezpieczeństwa.

Seniorzy używają AI nie po to, by „napisała im kod”, ale żeby zwiększyć przepustowość zespołu, wyrównać poziom juniorów, usprawnić przeglądy i porządki w projekcie. Dla doświadczonych inżynierów AI jest dźwignią, nie kulą u nogi.

Praktyczny przykład przyspieszonego POC

W typowym zespole produktowym trzeba przygotować POC integracji z nowym zewnętrznym API płatności. Bez AI: analiza dokumentacji, ręczne pisanie klienta HTTP, mapowanie odpowiedzi, podstawowe testy integracyjne – kilka dni pracy dwóch osób. Z wykorzystaniem narzędzi AI:

- model generuje szkic klienta na podstawie fragmentu dokumentacji API,

- asystent w IDE podpowiada testy integracyjne i obsługę najczęstszych błędów HTTP,

- chat techniczny tworzy zwięzły opis integracji i przykładowe scenariusze.

Czas do działającego POC spada z kilku dni do kilku godzin. Jednocześnie etap „utwardzenia” rozwiązania (bezpieczeństwo, obsługa wyjątków, monitoring, logowanie, zgodność z regulacjami) nadal wymaga doświadczonych programistów. AI przyspiesza wejście na ring, ale nie wyręcza w walce.

Przegląd kluczowych narzędzi AI w pracy programisty

Główne kategorie narzędzi AI dla programistów

Aby dobrze wykorzystać AI w pracy programisty, trzeba rozumieć, że różne narzędzia obsługują różne etapy cyklu wytwórczego. Najczęściej spotykane kategorie to:

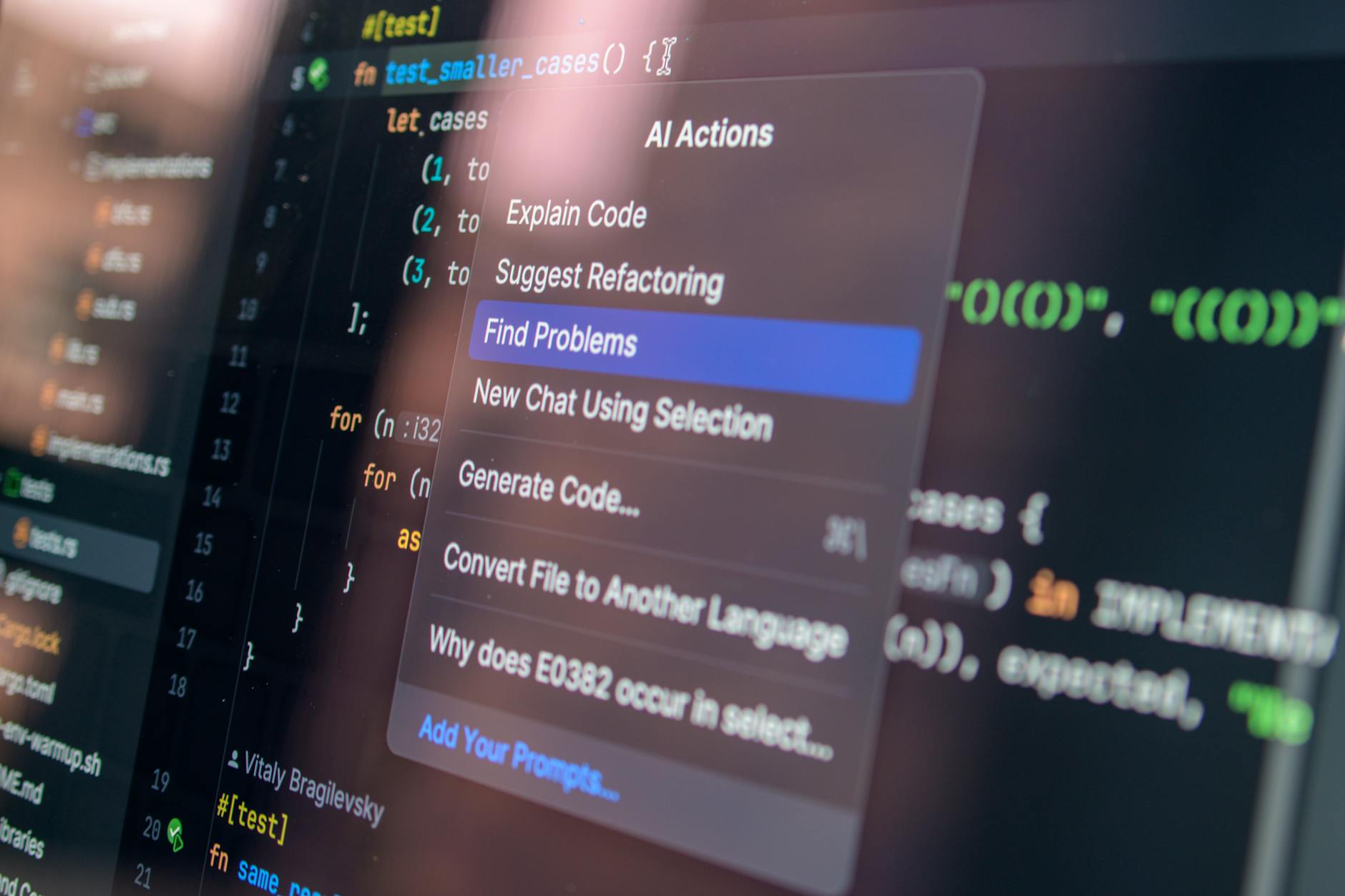

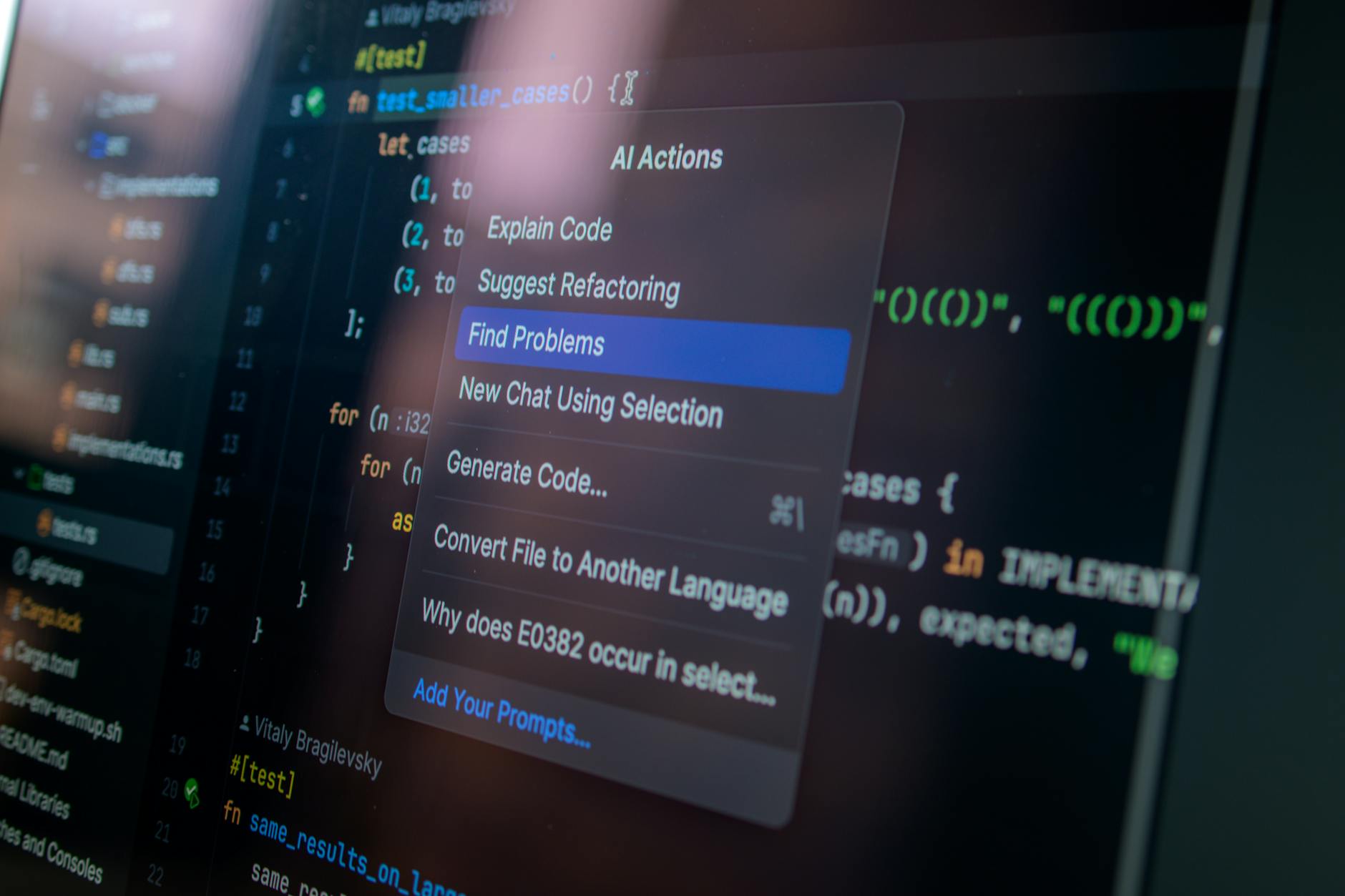

- Asystenci w IDE – podpowiedzi kodu w czasie pisania (Copilot, Codeium, Tabnine, wbudowani asystenci VS Code / JetBrains).

- Chaty techniczne – narzędzia typu ChatGPT, Claude, Google Gemini do dyskusji o koncepcjach, bugach, fragmentach kodu.

- Narzędzia do code review – automatyczne komentarze do pull requestów, wskazywanie potencjalnych błędów i niespójności.

- Narzędzia testujące – generowanie testów jednostkowych, integracyjnych, scenariuszy edge-case na podstawie kodu.

- Generatory dokumentacji – tworzenie opisów API, README, changelogów, komentarzy do złożonych funkcji.

Jeden z częstszych błędów polega na używaniu jednego narzędzia do absolutnie wszystkiego. Praktyka pokazuje, że wydajniejsze jest połączenie dwóch–trzech rozwiązań: asystenta w IDE, chatbota technicznego oraz narzędzia wspierającego code review i testy.

Przykładowe rozwiązania i ich typowe zastosowania

Rynek narzędzi AI dla programistów jest dynamiczny, ale pewne nazwy pojawiają się szczególnie często:

- GitHub Copilot / Copilot Chat – integracja z VS Code, JetBrains; bardzo mocne podpowiedzi kodu, generowanie funkcji, testów, dialog kontekstowy o projekcie.

- Codeium – darmowy asystent kodu, obsługa wielu IDE, autouzupełnianie, chat, dobre wsparcie dla różnych języków.

- Tabnine – podpowiedzi kodu, nacisk na prywatność i możliwość trenowania na własnym kodzie.

- Amazon CodeWhisperer – integracja z AWS, podpowiedzi kodu, snippetów i wzorców korzystania z usług chmurowych.

- ChatGPT / Claude / inne modele ogólne – dyskusja o architekturze, wyjaśnianie błędów, generowanie koncepcji, dokumentacji, przykładowych implementacji.

Asystenci wbudowani w JetBrains lub VS Code potrafią łączyć autouzupełnianie z kontekstem całego repozytorium, co ma duże znaczenie przy większych projektach. Dobrze dobrany zestaw narzędzi skraca czas przełączania się między kontekstami i minimalizuje „szum” podpowiedzi.

Na co zwracać uwagę przy wyborze narzędzia

Przy wyborze narzędzi AI w programowaniu liczy się kilka praktycznych kryteriów:

- Prywatność i bezpieczeństwo – czy kod projektu jest wysyłany poza organizację? Czy można ograniczyć dane przesyłane do modelu? Czy istnieje opcja on-premise lub „private mode”?

- Wsparcie dla języków i technologii – czy narzędzie „rozumie” Twój główny stack (backend, frontend, mobilne, DevOps)?

- Integracja z IDE – szybkość, jakość podpowiedzi, możliwość wywołania chatu z zaznaczonego fragmentu kodu.

- Koszt vs skala zespołu – licencje per użytkownik, modele rozliczeń, wartość w stosunku do czasu zaoszczędzonego przez zespół.

- Możliwość pracy na własnym kodzie – trenowanie modeli na prywatnym repozytorium, lepsze dopasowanie do stylu i architektury projektu.

W organizacjach bardziej regulowanych (finanse, medycyna, sektor publiczny) kluczowe stają się kwestie zgodności z regulacjami (np. brak wysyłania danych osobowych czy tajemnicy handlowej do zewnętrznych usług). Tam często wygrywają rozwiązania, które można osadzić w infrastrukturze firmy.

Modele ogólne vs narzędzia szyte pod programistów

Ogólne modele AI (general-purpose LLM) świetnie nadają się do:

- wyjaśniania koncepcji (np. jak działa event sourcing, CQRS, garbage collector),

- projektowania architektury na poziomie wysokiego poziomu,

- tworzenia dokumentacji, opisów, scenariuszy testowych.

Narzędzia skrojone pod programistów oferują natomiast:

- podpowiedzi kodu w czasie rzeczywistym,

- świadomość kontekstu plików i repozytorium,

- dedykowane komendy („wyjaśnij tę funkcję”, „zaproponuj testy”, „zrefaktoryzuj do wzorca Strategy”).

Mit, że „jedno narzędzie zrobi wszystko”, nie wytrzymuje zderzenia z praktyką. Ogólny model może napisać też kod, ale bez ścisłej integracji z IDE i repozytorium szybko robi się mniej użyteczny niż asystent wyspecjalizowany w programowaniu. Z drugiej strony – asystent w IDE bez możliwości luźnej rozmowy o architekturze i wymaganiach również ogranicza potencjał.

Porównanie typów narzędzi AI w programowaniu

| Typ narzędzia | Mocne strony | Słabe strony | Przykładowe zastosowania |

|---|---|---|---|

| Asystent w IDE | Szybkie podpowiedzi kodu, znajomość kontekstu pliku | Ograniczona „rozmowność”, czasem powierzchowne rozumienie architektury | Boilerplate, uzupełnianie funkcji, proste testy |

| Chat techniczny | Głębsze wyjaśnienia, praca koncepcyjna, dyskusja | Brak pełnej integracji z IDE, potrzeba ręcznego kopiowania kodu | Projektowanie, debugowanie, dokumentacja |

| Code review AI | Szybkie wykrywanie typowych błędów i antywzorców | Nie zastąpi pełnego review architektonicznego | Wstępny przegląd PR, wsparcie dla human reviewerów |

| Narzędzia testujące | Generowanie szkiców testów i scenariuszy | Brak pełnego pokrycia, koncentracja na „happy path” | Start projektu testowego, rozszerzanie istniejących test |

Przykłady workflow z różnymi narzędziami

Dobrze dobrany zestaw narzędzi AI pracuje jak zgrany zespół, a nie jak kilku solistów grających każdy swoje. Najprostszy, a przy tym skuteczny układ to:

- asystent w IDE do podpowiedzi i drobnych zmian w kodzie,

- chat techniczny do szerszych pytań i analizy fragmentów repozytorium,

- automatyczny code review i generator testów jako „filtr” na pull requestach.

Przykładowy dzień pracy backend developera może wyglądać tak: projektowanie struktury modułu w chacie (z krótkim opisem kontekstu domenowego), szkic implementacji w IDE z podpowiedziami AI, szybkie wygenerowanie testów jednostkowych, a na końcu PR przechodzący przez automat wykrywający najczęstsze wpadki (brak walidacji, nieużywane zmienne, potencjalne NPE). Programista decyduje, co przyjąć, a co wyrzucić – AI tylko przyspiesza „przemiał”.

Jak efektywnie używać AI jako „pair programmera”

Różnica między asystentem a autopilotem

Najzdrowsze podejście do AI w kodowaniu to traktowanie narzędzia jak partnera dyskusji, nie jak pilota, który sam doleci do celu. Pair programming z człowiekiem polega na tym, że dwie osoby analizują problem, kwestionują swoje pomysły, tłumaczą intencje i patrzą na kod z różnych perspektyw. AI da się w to włączyć, jeśli świadomie ustawisz role:

- Ty – rozumiesz domenę, cele biznesowe, ograniczenia systemu.

- AI – zna ogromny zbiór wzorców, idiomów i rozwiązań z różnych języków.

Mit, że „pair programming z AI zastąpi partnera z zespołu”, szybko upada w zderzeniu z realnymi systemami. Maszyna nie zna polityki firmy, kontekstu organizacyjnego ani planów produktu. Świetnie podpowie algorytm, ale nie podejmie odpowiedzialnej decyzji architektonicznej.

Jak formułować skuteczne „prompty” techniczne

Rozmowa z AI przestaje być loterią, gdy zaczynasz podawać jej sensowny kontekst. Zamiast wrzucać suchy fragment kodu i pisać „napraw to”, lepiej zastosować prostą strukturę:

- Kontekst: opis modułu, technologii, ograniczeń (np. „system płatności, Java + Spring, mikroserwis, duży ruch”).

- Cel: czego oczekujesz („chcę zmniejszyć złożoność tej klasy”, „szukam potencjalnych wycieków pamięci”).

- Wejście: konkretny kod lub opis problemu.

- Ograniczenia: np. „nie zmieniaj publicznego API”, „zachowaj istniejące logowanie błędów”.

Przykład: zamiast „napisz testy”, bardziej produktywne jest: „Napisz testy jednostkowe dla tej klasy (fragment poniżej) w JUnit 5, z użyciem Mockito. Skup się na przypadkach brzegowych (błędne parametry, timeout z zewnętrznego API). Nie zmieniaj implementacji klasy produkcyjnej, tylko zaproponuj testy w oddzielnym pliku”.

Ustalanie roli AI w zależności od zadania

Rola, jaką przypisujesz AI, powinna zależeć od typu pracy:

- Projektowanie – traktuj AI jak konsultanta: „jakie są alternatywy?”, „jakie są typowe problemy w takim wzorcu?”. Niech generuje opcje, a nie gotowy projekt.

- Implementacja – użyj AI jako generatora szkiców i gotowych idiomów. Ty definiujesz interfejsy, kontrakty i edge-case, AI pomaga z wypełnieniem środka.

- Debugowanie – AI bywa skuteczne jako „druga para oczu”, która szuka nieoczywistych zależności albo sugeruje inne punkty logowania.

Jeżeli na każdym etapie próbujesz zrzucić na AI pełną odpowiedzialność („zaprojektuj, zaimplementuj i przetestuj za mnie”), zwykle kończy się to powstaniem CR-owego potwora, który przechodzi kompilację, ale nie nadaje się do utrzymania.

Przykład sesji „pair programming” z AI

Wyobraź sobie, że implementujesz obsługę refundów w module płatności. Zamiast od razu kazać AI „napisać klasę RefundService”, możesz przejść sekwencję:

- Prosisz AI o listę typowych przypadków refundów w systemach e-commerce (częściowy zwrot, zwrot po kilku miesiącach, chargeback itp.).

- Wspólnie szkicujecie prosty model domenowy (komendy, zdarzenia, stany zamówienia).

- Definiujesz interfejsy usług i kontrakty. Dopiero wtedy prosisz AI o szkic implementacji poszczególnych metod.

- Na końcu prosisz o propozycję testów jednostkowych i integracyjnych pod ten model.

Efekt: dostajesz kod, który powstał z Twojej wizji procesu, a AI wniosło katalog gotowych rozwiązań oraz przyspieszenie pisania. Rzeczywistość jest taka, że jakość końcowego kodu rośnie nie wtedy, gdy AI pisze więcej, tylko gdy Ty lepiej prowadzisz rozmowę.

Generowanie kodu: od szkicu do produkcji, bez ślepego zaufania

Jak ustawiać oczekiwania wobec generowanego kodu

Generatory kodu robią ogromne wrażenie przy pierwszym użyciu: kilka zdań opisu i pojawia się działająca funkcja albo cały kontroler. Pułapka pojawia się wtedy, gdy zaczynasz zakładać, że „skoro się kompiluje, to jest dobrze”. Modele językowe celują w kod, który:

- jest syntaktycznie poprawny,

- przypomina wzorce z publicznych repozytoriów,

- pasuje do kontekstu, który im podałeś.

To nie jest to samo, co: „bezpieczny, zoptymalizowany, zgodny z regulacjami, odporny na nadużycia użytkowników”. W praktyce generowany kod jest dobrym punktem startowym, a nie „prawie produkcją”.

Strategia „najpierw kontrakt, potem generacja”

Bezpieczniejszy sposób korzystania z AI to podejście kontraktowe. Najpierw definiujesz:

- sygnatury funkcji / interfejsów,

- inwarianty (co musi być zawsze prawdą),

- konkretne przypadki wejść/wyjść.

Dopiero potem prosisz narzędzie o wypełnienie środka implementacji. Na przykład: sam projektujesz interfejs PriceCalculator i opisujesz reguły rabatowe w komentarzach, a generację logiki delegujesz AI z dopiskiem: „uwzględnij wszystkie opisane wyjątki, w tym kombinacje rabatów i minimalną marżę”.

Mit, że „AI wymyśli lepszy kontrakt”, zazwyczaj jest tylko wymówką, żeby nie opisywać wymagań. Kontrakt to znajomość domeny i wymagań biznesowych – obszar, w którym programista ma przewagę nad modelem.

Checklisty sanity-check dla kodu z AI

Zamiast wierzyć „na słowo”, warto przyjąć krótki zestaw pytań do każdego większego kawałka kodu wygenerowanego przez model:

- Czy są walidowane dane wejściowe (w tym null, pusty string, nieprawidłowy format)?

- Czy obsługa błędów jest spójna z resztą systemu ( wyjątki, kody HTTP, logowanie)?

- Czy wywołania zewnętrzne mają timeouty, retry z backoffem, zabezpieczenie przed lawiną?

- Czy w kodzie nie zostały „magiczne liczby”, twardo zakodowane URL-e lub klucze?

- Czy nie ma ukrytych założeń specyficznych dla innego środowiska (np. ścieżki w systemie plików)?

Dobrą praktyką jest też poproszenie AI o „recenzję” własnego wygenerowanego kodu pod kątem bezpieczeństwa i edge-case. Model bywa w stanie wskazać swoje własne skróty myślowe, gdy eksplicytnie poprosisz: „Wskaż potencjalne problemy z bezpieczeństwem w tym kodzie, w szczególności SQL injection, XSS, CSRF, wycieki danych osobowych”.

Unikanie „kopiuj-wklej” z chatu do produkcji

Pokusą jest wrzucanie gotowych snippetów prosto z chatu do repozytorium. Skutki widoczne są po kilku miesiącach: fragmenty kodu nie pasują stylem, powtarzają logikę, omijają istniejące abstrakcje. Zamiast tego:

- Wklej kod z AI do branchu roboczego lub eksperymentalnego pliku.

- Dostosuj nazwy, zależności i style do konwencji projektu.

- Sprawdź, czy istnieją już podobne moduły – może lepiej rozszerzyć istniejące API, zamiast tworzyć nowe.

- Dodaj testy (również wygenerowane przez AI, ale świadomie przeglądane).

Rzeczywistość jest taka, że „bezrefleksyjne kopiuj-wklej” z AI jest tylko trochę lepszą wersją kopiowania z losowego bloga. Zyskujesz szybkość, ale ryzykujesz spójność systemu.

Przykład: od promptu do gotowego modułu

Załóżmy, że masz zaprojektować prosty moduł uploadu plików do chmury z walidacją typu MIME i limitem rozmiaru. Bez AI piszesz wszystko ręcznie. Z AI proces może wyglądać tak:

- Definiujesz interfejs

FileStoragei opisujesz wymagania w komentarzach. - Prosisz AI o implementację przeciwko konkretnej chmurze (np. S3) z uwzględnieniem time-outów i retry.

- Prosisz o wygenerowanie testów jednostkowych z mockiem klienta S3.

- Na końcu prosisz AI o listę możliwych ataków na taki moduł (np. upload złośliwych plików, oversize attacks) i ręcznie weryfikujesz, czy kod jest na nie odporny.

Zamiast „AI napisała mi moduł”, masz sytuację, w której AI była wsparciem w każdym kroku, a Ty zachowujesz kontrolę nad odpowiedzialnością i bezpieczeństwem.

Refaktoryzacja, testy i dokumentacja z pomocą AI

Refaktoryzacja: porządkowanie zamiast przepisywania

AI bywa kuszona do dużych refaktoryzacji typu „przepisz ten moduł na nowo”. Z perspektywy utrzymania systemu znacznie rozsądniej jest prosić o małe, lokalne zmiany:

- wydzielenie fragmentów do prywatnych metod,

- zastąpienie powielonego kodu wspólnym helperem,

- propozycje bardziej czytelnych nazw zmiennych i metod,

- transformację do konkretnego wzorca (Strategy, Template Method, CQRS) przy zachowaniu interfejsów.

Mit, że „AI zrobi wielką refaktoryzację szybciej i lepiej”, rozjeżdża się z faktami przy systemach z dużą ilością stanów i skomplikowanym domain knowledge. Model widzi kształt kodu, ale nie zna wszystkich niejawnych zależności z zewnętrznymi systemami czy procesami biznesowymi.

Technika „refactor & explain”

Ciekawym zastosowaniem jest połączenie refaktoryzacji z generowaniem wyjaśnień. Zamiast kazać AI „po prostu uprościć tę klasę”, możesz:

- Poprosić o diagnozę: „Wyjaśnij, dlaczego ta klasa jest trudna w utrzymaniu. Oceniaj pod kątem complexity, coupling, SRP”.

- Na bazie diagnozy poprosić o konkretne zmiany: „Zaproponuj refaktoryzację, która zmniejszy liczbę odpowiedzialności tej klasy, bez zmiany publicznego API”.

- Na końcu poprosić o krótkie podsumowanie w stylu commit message: „Opisz, jakie decyzje projektowe stoją za tą refaktoryzacją”.

Taki workflow nie tylko dostarcza lepszy kod, ale też przyspiesza onboard nowych osób w zespole. Mogą prześledzić historię zmian i od razu rozumieć, po co dana refaktoryzacja powstała.

Generowanie testów: od „happy path” do przypadków brzegowych

AI świetnie radzi sobie z tworzeniem podstawowych testów jednostkowych, zwłaszcza dla czystych funkcji i prostych serwisów. Typowy wzorzec:

- wskazujesz klasę lub funkcję,

- prosisz o testy w konkretnym frameworku (JUnit, pytest, Jest, PHPUnit),

- dodajesz wytyczne: „uwzględnij przypadki błędne, wartości graniczne, null, puste dane”.

Wielu programistów zatrzymuje się na tym etapie, akceptując to, co wygeneruje model. Tymczasem testy generowane automatycznie często skupiają się na ścieżce „wszystko jest dobrze” i nie wychwytują subtelnych regresji. Dobrym nawykiem jest:

- przeczytanie wygenerowanych testów pod kątem tego, czego brakuje, a nie tylko tego, co jest,

- doproszenie AI o „nietypowe przypadki użycia”, np. konkurecyjne modyfikacje, wyścig o zasób, nagłe restarty,

- podbicie poziomu asercji: z „czy nie rzuca wyjątku” do „czy wynik spełnia konkretne inwarianty biznesowe”.

Z perspektywy jakości systemu kluczowe jest to, że to programista definiuje, co jest ważnym przypadkiem testowym. AI może pomóc je spisać i zaimplementować, ale nie zna szczegółów Twojego SLA, polityki błędów czy wymagań regulacyjnych.

Testy regresyjne i analiza istniejącego pokrycia

Testy generowane z logów i realnych incydentów

Czysta teoria rzadko wyłapuje najbardziej bolesne bugi. Dobrą praktyką jest łączenie AI z danymi z produkcji: logami, raportami błędów, opisami incydentów. Schemat działania może wyglądać tak:

- Eksportujesz fragmenty logów z konkretnym wyjątkiem lub nietypowym zachowaniem.

- Anonimizujesz dane (ID użytkowników, e-maile, numery zamówień, IP).

- Podajesz AI opis incydentu + stack trace + skrócone logi z prośbą: „Zaproponuj test regresyjny, który odtworzy ten błąd”.

Model jest w stanie zaproponować:

- konkretny zestaw danych wejściowych, który wywołuje błąd,

- strukturę testu (np. „powtórz operację trzy razy równolegle”),

- dodatkowe asercje sprawdzające, że błąd nie wróci inną drogą.

Zamiast ogólnego „piszmy więcej testów”, zamieniasz realne awarie na konkretne scenariusze w kodzie testowym. AI robi tu żmudną robotę: czyta długie logi, skleja wątki, proponuje minimalny przypadek, który odtwarza problem.

Audyt pokrycia testów z pomocą AI

Kolejne zastosowanie to szybki przegląd, czego nie testujesz. Narzędzia typu coverage pokazują linie bez testów, ale nie mówią, czy to realny problem. Tutaj AI potrafi przejść przez:

- raport pokrycia (np. w formacie HTML/JSON),

- krytyczne moduły (płatności, autoryzacja, integracje),

- aktualne testy jednostkowe i integracyjne,

i zaproponować listę „dziur” nie tylko na poziomie linii kodu, ale całych przypadków biznesowych. Typowe wnioski:

- „Brak testów anulowania płatności po przekroczeniu limitu czasu.”

- „Nie ma scenariusza, w którym token JWT wygasł w trakcie dłuższej operacji.”

- „Brak testów migracji danych dla starej wersji schematu.”

Mit, że „80% coverage = jesteśmy bezpieczni”, jest wygodny, ale mylący. Pokrycie to liczba techniczna; AI może pomóc przetłumaczyć ją na język ryzyka biznesowego i wskazać, które braki naprawdę są groźne.

Dokumentacja: z chaosu commitów do sensownego opisu

Najbardziej niedofinansowany obszar w projektach to dokumentacja. AI świetnie radzi sobie z:

- porządkowaniem chaotycznych notatek w zwięzłe README,

- generowaniem krótkich opisów modułów na podstawie kodu,

- tworzeniem sekwencji kroków „jak uruchomić środowisko lokalne”.

Praktyczny workflow:

- Zrzucasz do AI:

- fragmenty kodu (np. główne serwisy),

- istniejące README,

- kilka commit message opisujących większe zmiany.

- Prosisz: „Stwórz aktualny opis architektury na poziomie modułów, z naciskiem na przepływy: rejestracja użytkownika, zakup, zwrot”.

- Następnie: „Przekształć to w skróconą wersję dla nowych devów: jak się podłączyć, które moduły są krytyczne, gdzie są testy end-to-end”.

Na końcu sam filtrujesz, co jest realnie przydatne, a co jest oczywistością. AI ma tendencję do dopisywania „best practices”, których nie stosujesz – takie fragmenty lepiej usuwać niż udawać, że system tak działa.

Kontrakt między kodem a dokumentacją

Ciekawy trik to używanie AI jako strażnika spójności między kodem i opisem. Przykład:

- wklejasz fragment dokumentacji API (np. opis endpointu REST),

- wklejasz aktualną implementację kontrolera,

- zadajesz pytanie: „Wypisz różnice między dokumentacją a implementacją. Wskaż pola, kody błędów i przypadki, które się rozjeżdżają”.

Model dość szybko wyłapuje, że dokumentacja obiecuje np. pole statusDetail, którego kod już nie zwraca, albo że 404 jest opisywane jako możliwy kod błędu, a w implementacji leci 400. Zamiast ręcznie przeklikiwać swaggera i kod, masz zwięzłą listę rozbieżności.

Mit, że „dokumentacja zawsze się zestarzeje i nic na to nie poradzimy”, słabo wytrzymuje zderzenie z narzędziami AI. Automatyczne porównywanie kodu i opisów obniża koszt aktualizacji na tyle, że staje się to realnym nawykiem, a nie heroiczna akcja raz na rok.

Styl kodu i standardy zespołowe

Code style zwykle pilnują lintery i formatery, ale nie wychwytują rzeczy typu:

- niespójne nazewnictwo (np.

userIdvscustomerIddla tej samej koncepcji), - różne konwencje obsługi błędów w sąsiednich modułach,

- inne wzorce dependency injection w obrębie jednego serwisu.

Tu AI może zadziałać jako „reviewer standardów”. W praktyce:

- Podajesz fragmenty kilku plików, które uważasz za „wzorcowe”.

- Definiujesz zasady: „używamy nazwy X dla tej domeny, wszystkie serwisy zwracają Result<T> z tym samym kontraktem błędu, logowanie idzie przez ten interfejs”.

- Wrzucasz nowy kod i prosisz: „Wskaż wszystkie miejsca, gdzie odstaję od tego stylu i zaproponuj zmiany nazw/struktur”.

To nie zastąpi code review, ale przypomina o rzeczach, które ludzkim recenzentom łatwo umykają przy zmęczeniu czy napiętych deadlinach.

Onboarding nowych członków zespołu

Nowa osoba w projekcie spędza tygodnie na czytaniu kodu i zadawaniu pytań. AI może tu pełnić rolę interaktywnego przewodnika – pod warunkiem, że ma dostęp do repozytorium (lokalnie lub przez narzędzie typu „AI IDE assistant”).

Praktyczne zastosowania:

- „Wyjaśnij, jak od żądania HTTP użytkownika dochodzimy do zapisu w bazie przy tworzeniu zamówienia. Wypisz pliki po drodze.”

- „Podaj 5 najważniejszych klas, które powinienem przeczytać, żeby zrozumieć moduł fakturowania.”

- „Na przykładzie tego taska z Jiry: wskaż, które fragmenty kodu trzeba zmodyfikować i jakie testy ruszyć.”

Mit, że „onboarding zawsze musi boleć kilka miesięcy”, staje się mniej oczywisty, gdy nowa osoba może zadawać kodowi pytania w języku naturalnym. Seniorzy nadal są źródłem wiedzy domenowej, ale nie muszą odpowiadać na każde techniczne „gdzie jest X?”.

AI jako wsparcie w code review, a nie automat akceptujący PR

Coraz więcej narzędzi oferuje „automatyczne review” pull requestów. Pokusa: kliknąć „przyjmij wszystkie sugestie” i mieć z głowy. Sensowniejsze podejście to traktowanie AI jako dodatkowego recenzenta, który:

- szuka powtarzających się schematów błędów (null, brak walidacji, brak logowania błędu),

- wskazuje niejasne nazwy i długie metody,

- proponuje alternatywne rozwiązania z krótkim uzasadnieniem.

Skuteczny pattern:

- Prosisz AI: „Zrób przegląd tego PR pod kątem bezpieczeństwa i performance, ignoruj kosmetykę stylu”.

- Filtrujesz sugestie – część to powtórka z lintera lub rzeczy nieistotne kontekstowo.

- Dopytujesz o konkretne punkty: „Wyjaśnij, czemu uważasz, że ta pętla jest potencjalnie wolna. Zaproponuj alternatywę z O(n) zamiast O(n²), jeśli to możliwe”.

Rzeczywistość jest taka, że AI potrafi złapać rzeczy, które umykają ludziom, ale też generuje fałszywe alarmy, bo nie widzi całego runtime’u, konfiguracji ani ruchu produkcyjnego. Ostateczna decyzja pozostaje po stronie człowieka – inaczej model szybko nauczy zespół ślepej akceptacji „bo tak zasugerował bot”.

Praca z legacy: archeologia z AI

Legacy systemy to miejsce, gdzie AI pokazuje pełnię użyteczności – pod warunkiem, że nie każesz mu „przepisywać wszystkiego na nowo”. Lepiej traktować je jak wykopalisko archeologiczne:

- „Streszcz, co robi ta 1500-liniowa klasa w 10 punktach biznesowych, bez wchodzenia w szczegóły implementacji.”

- „Wypisz wszystkie zewnętrzne systemy, z którymi komunikuje się ten moduł, na podstawie importów i wywołań.”

- „Podziel tę funkcję na mniejsze, proponując naturalne granice odpowiedzialności, ale bez zmiany logiki.”

Często wychodzi wtedy na jaw, że jedna klasa:

- parsuje dane z trzech formatów,

- robi walidację,

- kontroluje transakcje,

- generuje raport PDF.

AI nie rozwiązuje problemu „długu technicznego” magicznie, natomiast przyspiesza jego mapowanie. Zamiast domyślać się tydzień, co gdzie jest, masz roboczy opis w godzinę, który możesz potem skorygować prawdziwą wiedzą domenową.

Planowanie refaktoryzacji z pomocą AI

Zamiast skakać na głęboką wodę typu „przepiszmy moduł rozliczeń”, sensowniej jest poprosić model o plan kroków:

- „Na podstawie tych plików zaproponuj małe, bezpieczne iteracje refaktoryzacji, które można zrealizować w 1–2 dni robocze każda.”

- „Dla każdej iteracji wypisz: zakres zmian, ryzyka, minimalny zestaw testów regresyjnych.”

- „Zaznacz, które kroki można robić równolegle różnymi osobami.”

Mit, że „albo wielka refaktoryzacja, albo nic”, zazwyczaj wynika z braku wyobrażenia, jak podzielić problem. AI w tym pomaga: rozcina słonia na kawałki i sugeruje, który z nich ugryźć pierwszy, a który zostawić na później.

Łączenie AI z narzędziami CI/CD

Narzędzia AI coraz częściej integrują się z pipeline’ami CI/CD. Zamiast ręcznie analizować każdy błąd builda, można:

- przekazać log z nieudanego builda do AI z pytaniem: „Jaki jest najbardziej prawdopodobny powód awarii i które pliki dotknąć?”

- poprosić: „Podsumuj w 5 punktach różnice między tym a poprzednim powodzeniem builda, skupiając się na dependency i migracjach DB”.

Przy złożonych monorepo skraca to czas diagnozy z „czytaj 5000 linii loga” do „zobacz te 3 newralgiczne miejsca”. Oczywiście model się myli, ale jako filtr szumu działa zaskakująco dobrze.

Współpraca z AI a rozwój umiejętności programisty

Pojawia się obawa: „skoro AI pisze kod za mnie, przestanę się rozwijać”. W praktyce dużo zależy od tego, jak z niego korzystasz. Dwa ekstrema:

- tryb kalkulatora: wrzucasz zadanie, bierzesz wynik, nie analizujesz – rozwój faktycznie zwalnia,

- tryb mentora: prosisz o rozwiązanie, potem każesz AI je wyjaśnić, porównać z alternatywami, policzyć złożoność – uczysz się szybciej niż z dokumentacji.

Dobry nawyk to:

- Najpierw samodzielnie szkicujesz rozwiązanie (nawet w głowie czy na kartce).

- Potem prosisz AI o swoją wersję i porównujesz: „Wskaż różnice między tymi dwoma podejściami, wady i zalety każdego pod kątem czytelności, wydajności i łatwości utrzymania”.

- Na końcu modyfikujesz kod, łącząc najlepsze elementy obu.

Rzeczywistość jest taka, że AI może być zarówno protezą, która rozleniwia, jak i dopalaczem nauki. Decyduje sposób zadawania pytań i gotowość do kwestionowania odpowiedzi modelu, zamiast przyjmowania ich jako „prawdy objawionej”.